La ciberseguridad empresarial como sistema complejo

Guido Rosales 30/03/2026

Fundamentos teóricos para la adopción de un enfoque adaptativo e innovador

La ciberseguridad empresarial como sistema complejo: fundamentos teóricos para la adopción de un enfoque adaptativo e innovador

Un análisis desde la teoría de sistemas complejos adaptativos hacia modelos de resiliencia organizacional en entornos digitales adversariales

Este artículo argumenta que la ciberseguridad empresarial constituye un sistema complejo adaptativo —no un dominio técnico acotado—, y que esta condición estructural invalida los modelos de gestión basados exclusivamente en control, cumplimiento y prevención. Partiendo de la teoría de sistemas complejos (Holland, Gell-Mann, Simon), se analizan las seis propiedades que caracterizan dicha complejidad en el contexto organizacional: interdependencia, no linealidad, emergencia, adaptabilidad adversarial, incertidumbre estructural y autoorganización sociotécnica. Se concluye que la transición hacia enfoques adaptativos, resilientes e innovadores no es opcional, sino estructuralmente necesaria en entornos digitales dinámicos.

Introducción

La ciberseguridad empresarial ha sido abordada, durante décadas, desde marcos normativos y técnicos que asumen un entorno predecible y controlable. Los marcos de referencia dominantes —ISO 27001, NIST, regulaciones sectoriales— presuponen que es posible diseñar controles suficientes para neutralizar amenazas conocidas. Sin embargo, la evidencia empírica acumulada revela un patrón perturbador: a mayor inversión en controles tradicionales, no necesariamente disminuye la frecuencia o el impacto de los incidentes de seguridad (Verizon DBIR, 2024).

Este artículo propone una reinterpretación conceptual: la ciberseguridad empresarial no es un problema técnico resuelto mediante suficiente control, sino un sistema complejo adaptativo que requiere enfoques radicalmente distintos. Esta tesis no es meramente filosófica; tiene consecuencias prácticas directas sobre cómo las organizaciones diseñan sus capacidades defensivas, asignan recursos y evalúan la madurez de su postura de seguridad.

"Un sistema complejo no se controla; se navega. La diferencia no es semántica: implica aceptar que la incertidumbre es una propiedad constitutiva del sistema, no un fallo de la gestión." — Síntesis conceptual del autor.

Fundamentos teóricos: ¿qué es un sistema complejo?

La teoría de sistemas complejos, desarrollada por Holland (1995) y Gell-Mann (1994) en el Santa Fe Institute, establece que ciertos sistemas no pueden ser comprendidos mediante el análisis aislado de sus partes. Su comportamiento global emerge de las interacciones entre componentes, genera propiedades impredecibles desde el nivel individual y evoluciona continuamente en función del entorno.

Un sistema complejo adaptativo (CAS, por sus siglas en inglés) añade una dimensión fundamental: sus agentes aprenden, se ajustan y modifican su comportamiento en respuesta a estímulos internos y externos. Esta capacidad de adaptación es simultáneamente la fortaleza y la fuente de mayor incertidumbre del sistema.

A diferencia de los sistemas complicados —donde el comportamiento puede descomponerse y entenderse de manera lineal—, los sistemas complejos presentan propiedades emergentes que solo pueden observarse en el conjunto. Esta distinción no es trivial: gestionar un sistema complicado requiere más información y mejores herramientas; gestionar un sistema complejo requiere un cambio de paradigma.

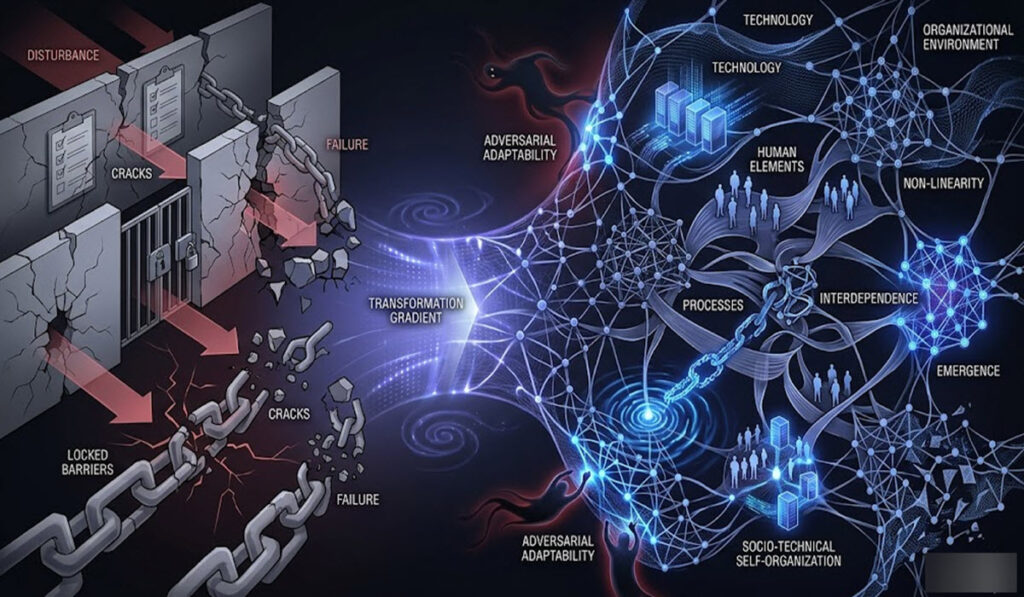

La ciberseguridad como sistema complejo: análisis por propiedades

A continuación, se analiza cómo la ciberseguridad empresarial cumple con cada una de las seis propiedades fundamentales de los sistemas complejos adaptativos. El análisis busca demostrar que esta correspondencia no es superficial ni metafórica, sino estructural.

| Propiedad del sistema complejo | Manifestación en ciberseguridad empresarial | Implicación para la gestión |

|---|---|---|

| Interdependencia estructural | Infraestructura, usuarios, procesos, regulaciones y terceros forman una red de dependencias mutuas | La seguridad no puede gestionarse por dominios aislados |

| No linealidad | Un phishing aparentemente menor puede desencadenar una brecha masiva (efecto Carbanak) | Los modelos de riesgo basados en proporcionalidad causa-efecto son estructuralmente insuficientes |

| Emergencia | Los incidentes surgen de la combinación de factores —humanos, técnicos, organizacionales— no de una causa única | La estrategia defensiva debe abordar condiciones sistémicas, no solo fallas puntuales |

| Adaptabilidad adversarial | Atacante y defensor coevolucionan: cada acción genera una respuesta que modifica el sistema | La ciberseguridad es un proceso dinámico, no un estado alcanzable |

| Incertidumbre estructural | Activos desconocidos, vulnerabilidades no identificadas, comportamiento humano impredecible | Las decisiones se toman bajo racionalidad limitada (Simon, 1957): la flexibilidad es una virtud, no un defecto |

| Autoorganización sociotécnica | Usuarios desarrollan prácticas informales (compartir credenciales, priorizar operación sobre seguridad) que modifican la postura de seguridad sin intervención central | El sistema sociotécnico debe ser gestionado, no solo el tecnológico |

La correspondencia entre estas propiedades y la realidad operativa de la ciberseguridad empresarial es consistente y mutuamente reforzante. Cada propiedad amplifica a las demás: la no linealidad hace que la interdependencia sea impredecible; la emergencia se alimenta de la autoorganización sociotécnica; la incertidumbre estructural es consecuencia directa de la adaptabilidad adversarial. El resultado es un sistema que resiste, por naturaleza, cualquier enfoque de gestión que asuma controlabilidad completa.

Limitaciones de los modelos deterministas

Los marcos normativos de ciberseguridad —sin negar su valor como línea base— presentan una limitación estructural cuando se aplican como estrategia suficiente: asumen que el sistema es predecible, que las amenazas son catalogables ex ante y que el cumplimiento equivale a seguridad. En un sistema complejo adaptativo, estas suposiciones no se sostienen.

El fenómeno conocido como compliance theater —la falsa sensación de seguridad derivada del cumplimiento normativo— es uno de los más documentados en la literatura de gestión de riesgos. Las organizaciones que satisfacen todos los controles requeridos continúan siendo vulnerables a ataques que explotan comportamientos emergentes, cadenas de suministro y factores sociotécnicos no contemplados en los marcos regulatorios.

Desde la perspectiva de Herbert Simon (1957), las decisiones en sistemas complejos se toman siempre bajo condiciones de racionalidad limitada: información incompleta, tiempo restringido y capacidad cognitiva finita. Esto no es un fallo del decisor; es una propiedad del entorno. Los modelos deterministas, al ignorar esta condición, generan respuestas subóptimas ante amenazas que evolucionan más rápido que los ciclos de actualización normativa.

Hacia un enfoque adaptativo: resiliencia como objetivo

Si aceptamos la complejidad como condición estructural, el objetivo de la ciberseguridad debe redefinirse. La pregunta ya no es "¿cómo prevenimos todos los incidentes?" —pregunta que presupone un sistema controlable— sino "¿cómo construimos capacidades para detectar, responder, recuperarnos y aprender más rápido que el adversario?"

Este desplazamiento conceptual habilita la incorporación de herramientas propias de sistemas adaptativos: sandbox environments, chaos engineering, ejercicios red/blue team, inteligencia de amenazas (CTI) y modelos de madurez adaptativa. En términos de Rogers (2003), la adopción de estas prácticas no es un lujo organizacional, sino una necesidad evolutiva para organizaciones que operan en entornos adversariales dinámicos.

La transición hacia modelos de resiliencia implica un cambio en las métricas de evaluación. El MTTD (Mean Time to Detect) y el MTTR (Mean Time to Respond) reemplazan al número de controles implementados como indicadores primarios de madurez. No se trata de eliminar los controles; se trata de reconocer que la velocidad de adaptación es tan crítica como la robustez de las defensas estáticas.

El rol de la innovación en sistemas complejos

En sistemas complejos, la innovación no complementa la estrategia de seguridad: la constituye. La imposibilidad de predecir todos los vectores de ataque posibles obliga a las organizaciones a desarrollar capacidades de experimentación continua. Esto implica no solo adoptar nuevas tecnologías, sino cultivar procesos organizacionales que permitan aprender de incidentes, incorporar inteligencia externa y adaptar controles en tiempo real.

Esta perspectiva se alinea con la teoría de difusión de innovaciones de Rogers (2003), donde la adopción progresiva de nuevas prácticas permite a las organizaciones adaptarse a entornos cambiantes. En el contexto adversarial de la ciberseguridad, la innovación tiene además una dimensión táctica: las organizaciones que innovan más rápido que sus adversarios generan una ventaja adaptativa sostenible, aunque asimétrica.

"La ciberseguridad que no innova es una fotografía del pasado en un mundo que se mueve." — Síntesis del autor.

Conclusión

El análisis presentado en este artículo permite afirmar que la ciberseguridad empresarial cumple, de forma estructural y no accidental, con todas las propiedades de un sistema complejo adaptativo. Esta condición tiene implicaciones directas sobre cómo se diseñan estrategias, se asignan capacidades y se evalúa la madurez de seguridad en organizaciones que operan bajo marcos regulatorios y entornos adversariales dinámicos.

La adopción de la teoría de sistemas complejos como base conceptual no reemplaza los marcos normativos existentes; los reencuadra. El cumplimiento pasa de ser un objetivo a ser una condición necesaria pero no suficiente. La resiliencia adaptativa —capacidad de detectar, responder, recuperarse y aprender más rápido que el adversario— se convierte en el horizonte estratégico relevante.

Este artículo contribuye a establecer el fundamento teórico desde el cual la investigación doctoral en curso —centrada en el desarrollo de un Modelo de Innovación Continua Adversarial para la construcción de capacidades adaptativas en ciberseguridad en entornos organizacionales regulados— encuentra su justificación conceptual más profunda.

Términos clave del artículo

| Término | Definición |

|---|---|

| Sistema complejo adaptativo (CAS) | Conjunto de agentes interconectados que aprenden y modifican su comportamiento en función del entorno, generando propiedades emergentes no predecibles desde sus componentes individuales (Holland, 1995). |

| Emergencia | Fenómeno por el cual un sistema exhibe propiedades o comportamientos globales que no están presentes ni son predecibles a partir del análisis de sus partes individuales. |

| No linealidad | Propiedad de los sistemas en los que pequeñas variaciones en las condiciones iniciales pueden producir efectos desproporcionados e impredecibles. |

| Autoorganización sociotécnica | Capacidad de los sistemas que combinan componentes humanos y tecnológicos para desarrollar estructuras y prácticas funcionales sin control central explícito. |

| Resiliencia adaptativa | Capacidad organizacional de absorber perturbaciones, reorganizarse y aprender de ellas manteniendo la continuidad operativa, con énfasis en la mejora continua de la respuesta. |

| Racionalidad limitada | Concepto de Herbert Simon que describe la toma de decisiones bajo condiciones de información incompleta, tiempo limitado y capacidad cognitiva finita. |

| Adaptabilidad adversarial | Dinámica de coevolución entre atacante y defensor en la que cada actor ajusta sus estrategias en respuesta a las acciones del otro, generando un ciclo continuo de innovación y contramedida. |

| Inteligencia de amenazas (CTI) | Conocimiento estructurado sobre tácticas, técnicas y procedimientos (TTPs) utilizados por actores adversariales, empleado para anticipar y neutralizar ataques. |

| MTTD / MTTR | Mean Time to Detect / Mean Time to Respond: métricas operacionales que cuantifican la velocidad de detección y respuesta ante incidentes de seguridad. |

| Compliance theater | Fenómeno en el que el cumplimiento formal de estándares y regulaciones genera una percepción de seguridad que no corresponde con la postura real de riesgo de la organización. |

| Sandbox | Entorno aislado y controlado utilizado para ejecutar, analizar o simular comportamientos potencialmente maliciosos sin riesgo para los sistemas productivos. |

| Chaos engineering | Disciplina de experimentación controlada sobre sistemas en producción, diseñada para identificar debilidades sistémicas antes de que se manifiesten como incidentes reales. |

Bibliografía

- Gell-Mann, M. (1994). The Quark and the Jaguar: Adventures in the Simple and the Complex. Freeman.

- Holland, J. H. (1995). Hidden Order: How Adaptation Builds Complexity. Addison-Wesley.

- Rogers, E. M. (2003). Diffusion of Innovations (5th ed.). Free Press.

- Simon, H. A. (1957). Models of Man: Social and Rational. Wiley.

- Teece, D. J., Pisano, G., & Shuen, A. (1997). Dynamic capabilities and strategic management. Strategic Management Journal, 18(7), 509–533.

- Verizon. (2024). Data Breach Investigations Report. Verizon Business.

- Weick, K. E. (1995). Sensemaking in Organizations. Sage Publications.

- NIST. (2018). Framework for Improving Critical Infrastructure Cybersecurity (v1.1). National Institute of Standards and Technology.