La Dinámica Adversarial en Sistemas Complejos: Un Marco para la Estabilidad en Ciberseguridad

Guido Rosales 29/03/2026

¿Es la seguridad un estado alcanzable o una condición dinámica?

La Dinámica Adversarial en Sistemas Complejos:

Un Marco para la Estabilidad en Ciberseguridad

Este trabajo propone un cambio de paradigma en ciberseguridad: entender la seguridad no como un estado que se alcanza, sino como un equilibrio dinámico sostenido entre cinco dimensiones interdependientes. Para ello introduce la adversarialidad como categoría analítica central — cualquier dinámica, intencional o no, que genera presión sobre ese equilibrio — y la clasifica en cinco tipos: intencional, no intencional, estructural, relacional e interna por traición. La tesis central: la adversarialidad es una propiedad emergente de los sistemas complejos, no una excepción. Las organizaciones que comprenden esto dejan de buscar la eliminación del riesgo y comienzan a desarrollar capacidades de navegación continua en entornos inherentemente adversos.

- 01 Introducción

- 02 Seguridad como Equilibrio Dinámico (CIA+)

- 03 Adversidad y Adversarialidad: Una Distinción Necesaria

- 04 La Adversarialidad como Propiedad Emergente

- 05 Tipología de la Dinámica Adversarial

- 06 Navegación en Entorno Adverso

- 07 El Cambio de Paradigma: Tabla Comparativa

- 08 Implicaciones para la Práctica Organizacional

- 09 Conclusiones

- — Referencias

- — Glosario de Términos

Introducción

El paradigma tradicional de la ciberseguridad se ha estructurado sobre una premisa deceptivamente simple: existe un atacante externo que intenta comprometer el sistema, y un defensor que debe impedirlo. Este modelo ha generado décadas de inversión en perímetros, firewalls, controles de acceso y sistemas de detección de intrusiones.

Sin embargo, cuando se analiza la seguridad en entornos organizacionales complejos — caracterizados por múltiples interacciones entre personas, procesos, tecnología y entorno regulatorio — este paradigma revela sus limitaciones estructurales. Los incidentes de seguridad más costosos no siempre provienen de atacantes sofisticados: muchos tienen origen en errores humanos, decisiones organizacionales subóptimas, dependencias con terceros mal gestionadas o arquitecturas técnicas que acumulan vulnerabilidades por diseño.

Este trabajo propone un marco conceptual que responde estas preguntas desde la teoría de sistemas complejos, reposicionando la ciberseguridad como una disciplina de gestión continua de equilibrios, no de eliminación de amenazas.

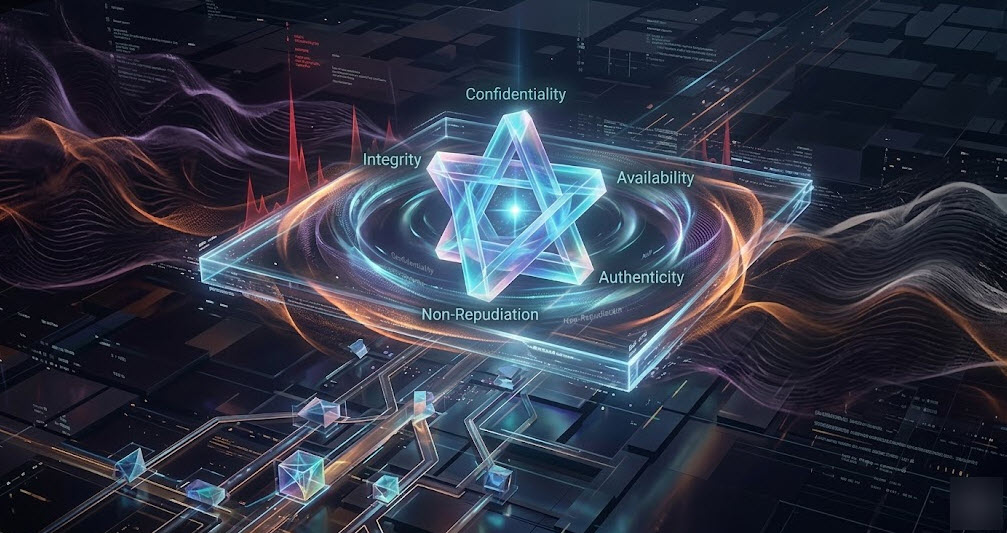

Seguridad como Equilibrio Dinámico: El Modelo CIA+

La ciberseguridad ha sido definida históricamente en torno a la tríada CIA: confidencialidad, integridad y disponibilidad. Este modelo es sólido como punto de partida, pero insuficiente en entornos digitales contemporáneos donde la autenticidad y el no repudio son igualmente críticos, especialmente en contextos de transacciones financieras, firma digital y trazabilidad regulatoria.

| Dimensión | Definición | Tensión adversarial típica |

|---|---|---|

| Confidencialidad | Solo los actores autorizados acceden a la información | Exfiltración, interceptación, exposición en dark web |

| Integridad | La información no ha sido alterada sin autorización | Manipulación de datos, inyección, falsificación de registros |

| Disponibilidad | El sistema opera cuando se lo necesita | DDoS, ransomware, corrupción de infraestructura |

| Autenticidad | Las entidades son quienes dicen ser | Suplantación, deepfakes, robo de identidad digital |

| No Repudio | Las acciones no pueden negarse después de realizadas | Eliminación de logs, manipulación de trazabilidad, fraude transaccional |

Estas cinco dimensiones no son objetivos independientes — forman un sistema de equilibrio. Una organización que refuerza disponibilidad a expensas de autenticidad (abriendo accesos para garantizar operatividad) está degradando su equilibrio general, aunque no lo perciba como una falla. La homeostasis, concepto biológico de Walter Cannon (1932), provee la analogía adecuada: la estabilidad no es ausencia de perturbación, sino capacidad de autorregulación continua frente a ella.

Adversidad y Adversarialidad: Una Distinción Conceptual Necesaria

Para comprender la dinámica de la seguridad en sistemas complejos, es necesario establecer una distinción que el lenguaje de la ciberseguridad frecuentemente colapsa:

La adversidad son las condiciones estructurales del entorno: incertidumbre, complejidad, interconexión tecnológica, dependencia de terceros, limitaciones cognitivas humanas. No puede eliminarse — es el mar en el que navega el sistema.

La adversarialidad es cualquier dinámica — intencional o no — que introduce presión, degradación o ruptura sobre los objetivos de seguridad del sistema dentro de ese entorno. No requiere un actor malicioso: puede ser el resultado de la propia complejidad del sistema operando sobre sí mismo.

Esta distinción tiene una implicación práctica inmediata: si la adversidad es el entorno, el objetivo de la seguridad no puede ser eliminarla. El objetivo es desarrollar la capacidad de operar dentro de ella manteniendo el equilibrio de las cinco dimensiones.

La Adversarialidad como Propiedad Emergente

Desde la teoría general de sistemas (Von Bertalanffy, 1968) y los enfoques de sistemas sociotécnicos (Trist y Emery, 1960), las organizaciones deben entenderse como estructuras donde múltiples elementos interactúan de manera no lineal, generando comportamientos que no pueden predecirse a partir del análisis individual de sus componentes.

En este contexto, la adversarialidad emerge de las propias interacciones del sistema. Un error humano en la configuración de un firewall crea una vulnerabilidad que ningún atacante diseñó. Una decisión de reducir el equipo de seguridad para optimizar costos degrada la capacidad de detección sin que nadie lo haya planeado como un ataque.

La teoría de la entropía en sistemas complejos (Prigogine) añade la dimensión temporal: todo sistema tiende al desorden si no se interviene activamente. La degradación de controles, la obsolescencia tecnológica y la acumulación de errores no son excepciones — son la trayectoria por defecto de cualquier sistema no gestionado activamente.

Tipología de la Dinámica Adversarial

A partir de la definición propuesta, la adversarialidad puede clasificarse en cinco tipos que cubren el espectro completo de fuentes de presión sobre el equilibrio de seguridad:

El Sistema como Navegación en Entorno Adverso

Una forma conceptualmente útil de integrar los elementos propuestos es mediante la analogía de la embarcación en entorno adverso. Esta metáfora no es meramente ilustrativa — tiene implicaciones directas sobre cómo se diseñan las capacidades de seguridad.

La adversidad es el mar: tormentas, corrientes, visibilidad limitada. Son condiciones del entorno que no se pueden cambiar; se puede diseñar una embarcación mejor y desarrollar mejores marineros. La adversarialidad son las dinámicas que afectan la estabilidad de la embarcación dentro de ese mar: errores de navegación, fallos estructurales del casco, conflictos entre la tripulación, o el sabotaje deliberado de un pasajero.

El objetivo de la ciberseguridad no es alcanzar un puerto tranquilo donde el mar no exista — ese puerto no existe en entornos digitales contemporáneos. El objetivo es desarrollar una embarcación que pueda navegar en condiciones adversas de forma continua, detectar cuando está perdiendo estabilidad antes de que vuelque, y recuperar el equilibrio con el menor costo posible.

El Cambio de Paradigma: Seguridad Estática vs. Equilibrio Dinámico

El enfoque propuesto implica una transformación sustancial en la forma de concebir, diseñar y gestionar la ciberseguridad:

| Dimensión | Paradigma tradicional | Equilibrio dinámico |

|---|---|---|

| Objetivo | Eliminar el riesgo | Gestionar el equilibrio continuo |

| Naturaleza de la seguridad | Estado que se alcanza | Proceso permanente de ajuste |

| Fuente del riesgo | Atacante externo | Adversarialidad emergente (5 tipos) |

| Modelo de respuesta | Reactivo ante incidentes | Adaptativo y anticipatorio |

| Foco de intervención | Perímetro y controles técnicos | Sistema sociotécnico completo |

| Indicador de éxito | Ausencia de incidentes | Velocidad de recuperación del equilibrio |

| Rol de la cultura | Secundario (concienciación) | Central (cultura adaptativa) |

| Temporalidad | Periódica (auditorías, revisiones) | Continua (monitoreo permanente) |

Implicaciones para la Práctica Organizacional

Conclusiones

Referencias

Cannon, W. B. (1932). The Wisdom of the Body. W. W. Norton.

MITRE Corporation. (2023). ATT&CK Framework v14. https://attack.mitre.org

National Institute of Standards and Technology. (2018). NIST Cybersecurity Framework v1.1. U.S. Department of Commerce.

Perrow, C. (1984). Normal Accidents: Living with High-Risk Technologies. Basic Books.

Prigogine, I., & Stengers, I. (1984). Order Out of Chaos: Man's New Dialogue with Nature. Bantam Books.

Trist, E., & Emery, F. (1960). Socio-Technical Systems. En C. W. Churchman & M. Verhulst (Eds.), Management Science, Models and Techniques (Vol. 2). Pergamon Press.

Von Bertalanffy, L. (1968). General System Theory: Foundations, Development, Applications. George Braziller.

Weick, K. E., & Sutcliffe, K. M. (2007). Managing the Unexpected: Resilient Performance in an Age of Uncertainty (2nd ed.). Jossey-Bass.

Glosario de Términos

Los siguientes términos constituyen el marco conceptual del presente trabajo, presentados en orden temático para facilitar su comprensión progresiva.