Del Human-in-the-Loop al Human-out-of-the-Loop: cuestion de sobrevivencia actual

Guido Rosales 07/04/2026El presente artículo propone una reinterpretación del rol humano en sistemas de ciberseguridad, planteando una transición hacia modelos human-on-the-loop y human-out-of-the-loop en capas operativas específicas. A partir del marco epistemológico GAMO —Gnoseológico, Axiológico, Metodológico y Ontológico— y la teoría de sistemas complejos adaptativos, se argumenta que la defensa efectiva requiere desplazar al humano del ciclo de decisión en tiempo real, reposicionándolo en niveles estratégicos y de diseño. Se propone además una dimensión de evaluación denominada “grado de autonomía operativa de seguridad”, como elemento clave en modelos de madurez contemporáneos.

Reconfiguración del control en ciberseguridad bajo entornos de alta adversarialidad y sistemas complejos adaptativos

Del Human-in-the-Loop al Human-out-of-the-Loop: reconfiguración del control en ciberseguridad bajo entornos de alta adversarialidad

Cuando la velocidad del ataque supera el tiempo cognitivo humano, el problema ya no es optimizar la reacción: es rediseñar quién decide, cuándo decide y desde qué capa del sistema.

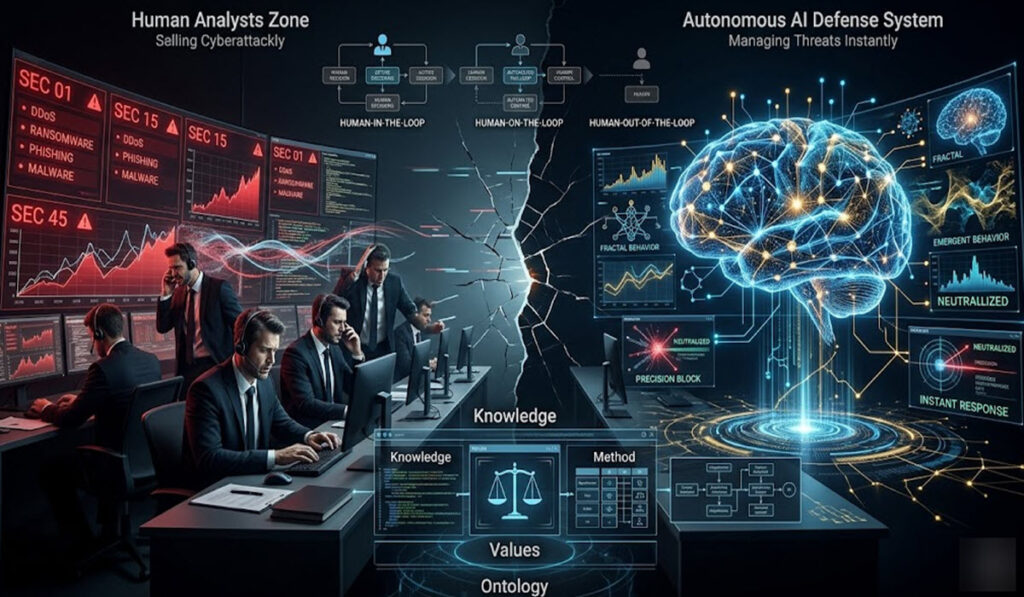

La aceleración de los ataques cibernéticos automatizados ha ampliado la brecha entre la velocidad del adversario y la capacidad de respuesta de los equipos humanos de seguridad. En escenarios donde el daño crítico puede ejecutarse en segundos, el paradigma human-in-the-loop deja de operar como garantía de control y empieza a convertirse en una fuente de latencia estructural. El presente artículo propone una reinterpretación del rol humano en la defensa digital, planteando una transición selectiva hacia modelos human-on-the-loop y human-out-of-the-loop en las capas operativas de alta velocidad. A partir del marco GAMO —gnoseológico, axiológico, metodológico y ontológico— y de la teoría de sistemas complejos adaptativos, se argumenta que la defensa contemporánea exige desplazar al humano del instante de decisión táctica, sin expulsarlo del sistema. Su función se reubica en el diseño de reglas, la supervisión del comportamiento automatizado, la gobernanza y la mejora continua. Como aporte, se propone el grado de autonomía operativa de seguridad como una dimensión evaluable dentro de modelos de madurez de ciberseguridad orientados a adversarialidad dinámica.

Introducción

Los modelos tradicionales de ciberseguridad han sido construidos sobre una premisa implícita: la intervención humana dentro del ciclo de decisión aporta control, criterio y contención. Esta premisa ha sido razonable mientras la velocidad del evento ha permanecido dentro de márgenes compatibles con el tiempo cognitivo humano. Sin embargo, la automatización ofensiva, la orquestación algorítmica y la capacidad de explotación en segundos han modificado radicalmente ese equilibrio.

En este nuevo escenario, la defensa enfrenta una contradicción estructural. Cuanto más intenta mantener al humano en el instante operativo, más introduce latencia. La reacción humana, antes signo de prudencia, puede convertirse en un cuello de botella. El problema ya no consiste únicamente en mejorar la detección, sino en rediseñar la arquitectura de decisión.

Este trabajo examina esa transición desde el human-in-the-loop hacia formas selectivas de human-on-the-loop y human-out-of-the-loop. El objetivo no es exaltar la automatización como dogma, sino identificar en qué capas la permanencia del humano deja de ser una garantía y pasa a ser una vulnerabilidad temporal.

Del control humano directo a la supervisión estratégica

El concepto human-in-the-loop describe sistemas en los cuales la decisión operativa requiere intervención humana antes de ejecutarse. En contextos de baja velocidad o alta irreversibilidad, esta lógica sigue siendo válida. No obstante, en incidentes que evolucionan en segundos —como mitigación de DDoS, bloqueo dinámico, respuesta automática a comportamiento anómalo o contención temprana— esa misma estructura se vuelve insuficiente.

La evolución de otros sectores de alta criticidad ilustra bien esta transición. En aviación, el piloto ya no corrige manualmente cada microvariación del vuelo; diseña, supervisa e interviene cuando el sistema sale de parámetros. En mercados algorítmicos ocurre algo similar: el humano define reglas, límites y prioridades, pero no ejecuta la microdecisión en tiempo real. La ciberseguridad avanza hacia una lógica análoga.

- El humano en el ciclo es eficaz cuando la velocidad del evento permite deliberación sin degradar la respuesta.

- El humano sobre el ciclo resulta más adecuado cuando el sistema puede actuar primero y el operador conserva capacidad de supervisión y corrección.

- El humano fuera del ciclo se vuelve necesario cuando el tiempo de impacto es menor que el tiempo mínimo de intervención humana.

El desplazamiento no implica una sustitución antropológica del decisor, sino una redistribución de funciones. El ser humano deja de ser el ejecutor inmediato y se convierte en arquitecto del comportamiento defensivo.

Continuo de intervención humana

La transición entre modelos no debe entenderse como una disyuntiva binaria. Entre el control manual total y la autonomía plena existe un continuo de configuraciones posibles. Este continuo permite adaptar el grado de intervención humana a la velocidad del evento, a la reversibilidad de la acción y al impacto sistémico de la decisión.

| Modelo | Caracterización operativa | Ventaja dominante | Riesgo principal |

|---|---|---|---|

| Human-in-the-loop | La acción requiere autorización humana previa. El sistema detecta o recomienda, pero no ejecuta por sí solo. | Mayor control deliberativo y trazabilidad decisional directa. | Latencia excesiva frente a eventos de alta velocidad. |

| Human-on-the-loop | El sistema ejecuta dentro de parámetros definidos y el humano supervisa, valida excepciones o redefine reglas. | Equilibrio entre velocidad operativa y gobernanza. | Dependencia de una buena configuración y supervisión activa. |

| Human-out-of-the-loop | El sistema detecta, decide y responde de forma autónoma en tiempo real, reservando al humano para análisis posterior y rediseño. | Máxima velocidad y consistencia táctica en entornos dinámicos. | Riesgo de automatizar errores o generar opacidad si la gobernanza es débil. |

La decisión sobre dónde ubicar al humano debe obedecer, al menos, a tres criterios. Primero, la velocidad del evento: si el daño se materializa antes de la reacción humana, el ciclo manual carece de sentido operativo. Segundo, la reversibilidad: acciones reversibles toleran mayor automatización que decisiones irreversibles. Tercero, el impacto sistémico: mientras más alto sea el efecto sobre el negocio, mayor debe ser la calidad de la gobernanza humana, aunque no necesariamente en tiempo real.

Análisis epistemológico GAMO

El desplazamiento del humano fuera del instante operativo no es solo un cambio tecnológico. También es una transformación en la manera de conocer, valorar, estudiar y comprender la defensa digital. El marco GAMO permite integrar estas cuatro dimensiones.

Propuesta de grado de autonomía operativa de seguridad

Como aporte conceptual, se propone el grado de autonomía operativa de seguridad como dimensión susceptible de incorporarse a modelos de madurez. Esta dimensión evalúa en qué medida una organización ha logrado desplazar decisiones operativas de alta velocidad hacia sistemas automatizados, manteniendo al humano en funciones de configuración, supervisión, auditoría y mejora.

| Nivel | Descripción | Rol del humano | Condición dominante |

|---|---|---|---|

| Nivel 0 | Operación manual sin automatización significativa. | Decide y ejecuta casi todo. | Alta dependencia de reacción humana. |

| Nivel 1 | Automatización asistida con herramientas de apoyo y validación constante. | Aprueba decisiones recomendadas por el sistema. | Baja velocidad con apoyo instrumental. |

| Nivel 2 | Automatización parcial en tareas específicas y repetitivas. | Supervisa ejecución parcial y atiende excepciones. | Coexistencia de control humano y respuesta automática. |

| Nivel 3 | Automatización supervisada con intervención humana excepcional. | Define umbrales, supervisa y corrige desvíos. | Predominio de human-on-the-loop. |

| Nivel 4 | Autonomía adaptativa en tiempo real basada en reglas, contexto y aprendizaje. | Arquitecto, auditor y rediseñador del sistema. | Predominio de human-out-of-the-loop en capa operativa. |

La utilidad de esta dimensión es doble. Por un lado, permite medir la brecha entre la capacidad defensiva y la velocidad del atacante. Por otro, introduce un criterio más realista de madurez: no basta con tener controles; importa si esos controles pueden actuar antes de que el daño entre en fase irreversible. El chiste cruel del atacante es que no te da tiempo ni para el café. Por eso la arquitectura importa más que la heroicidad del analista.

Discusión

La propuesta no equivale a una defensa ciega de la autonomía algorítmica. Existen riesgos asociados: sesgo de automatización, opacidad de decisiones, dependencia excesiva del proveedor tecnológico y dificultad de explicar acciones autónomas en entornos regulados. Estas limitaciones obligan a que el desplazamiento del humano no se haga de forma ingenua, sino bajo marcos robustos de gobierno, trazabilidad y revisión.

Sin embargo, el problema inverso también debe reconocerse. Mantener intervención humana donde ya es operacionalmente inviable produce una ilusión de control. Ese sesgo organizacional se parece mucho a lo que la teoría de sistemas denomina homeostasis aparente: el sistema parece bajo control, pero solo porque todavía no ha sido sometido a una velocidad para la cual fue mal diseñado.

En consecuencia, la discusión central no es si la IA o la automatización deben participar, sino dónde, bajo qué límites, con qué gobernanza y con qué capacidad de auditoría. El debate correcto ya no es hombre versus máquina, sino sistema mal diseñado versus sistema capaz de responder a la velocidad del riesgo.

Conclusiones

Términos clave del artículo

Referencias

Holland, J. H. (1992). Adaptation in natural and artificial systems. MIT Press.

Parasuraman, R., Sheridan, T. B., & Wickens, C. D. (2000). A model for types and levels of human interaction with automation. IEEE Transactions on Systems, Man, and Cybernetics - Part A, 30(3), 286–297.

Sheridan, T. B. (2006). Supervisory control and the coming of age of information technology. Annual Reviews in Control, 30(1), 3–18.

Weick, K. E., & Sutcliffe, K. M. (2015). Managing the unexpected: Sustained performance in a complex world. Wiley.

Woods, D. D., & Hollnagel, E. (2006). Joint cognitive systems: Patterns in cognitive systems engineering. CRC Press.

Zuboff, S. (2019). The age of surveillance capitalism. PublicAffairs.

Guido E. Rosales Uriona (Doctorante) · Doctorado en Innovación y Emprendimiento · UCB San Pablo · 2026

Línea de investigación: Innovación adversarial en sistemas complejos